La Inteligencia Artificial (IA) ha dejado de ser ciencia ficción para convertirse en una presencia cotidiana. Está en nuestros móviles, en los bancos, en la sanidad, en las aulas… Incluso decide qué vemos en las redes sociales o qué tratamiento médico puede recomendarnos un hospital. Pero con tanto poder, surge una pregunta incómoda: ¿podemos confiar plenamente en estas decisiones?

En nuestra reciente exposición, exploramos un tema tan fascinante como preocupante: los sesgos en la Inteligencia Artificial. Esos errores invisibles que no solo pueden alterar resultados, sino perpetuar discriminación y desigualdad en el mundo real. Porque sí, los algoritmos también heredan prejuicios humanos, y eso tiene consecuencias.

¿Qué es un sesgo en la IA?

Imagina un sistema que decide a quién contratar, a quién aprobar un crédito o incluso a quién vigilar. Ahora imagina que ese sistema ha sido entrenado con datos que reflejan desigualdades históricas: más hombres contratados que mujeres, menos préstamos para personas racializadas, o imágenes estereotipadas de profesiones según el género. El resultado: una tecnología que no es neutral, sino profundamente influenciada por el pasado.

Durante nuestra investigación, descubrimos distintos tipos de sesgos: desde los de datos (cuando la información está mal seleccionada), hasta los algorítmicos (cuando el diseño mismo favorece ciertos resultados), pasando por sesgos de automatización, selección, medición o lenguaje. Todos pueden parecer pequeños, pero sumados, tienen un impacto enorme.

Casos reales que nos hicieron reflexionar

Algunos ejemplos que nos impactaron fueron:

-

El sistema de contratación de Amazon que penalizaba CVs con la palabra "mujeres".

-

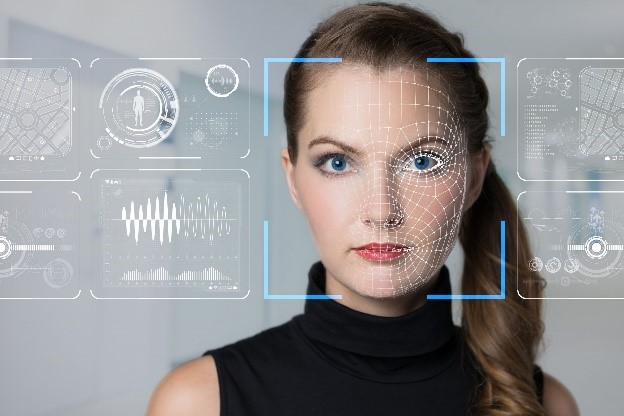

Herramientas de reconocimiento facial con tasas de error altísimas en personas de piel oscura.

-

Apple Card asignando menos crédito a mujeres, incluso con perfiles económicos similares a los de los hombres.

-

Chatbots generando imágenes estereotipadas: peluqueras siempre mujeres, taxistas siempre hombres.

Estos casos no solo ilustran cómo el sesgo se cuela en la tecnología. También muestran por qué es urgente actuar. La IA tiene poder real. Y si no la controlamos, puede reforzar injusticias ya existentes.

¿Qué podemos hacer?

En la última parte de nuestra exposición, propusimos soluciones claras: auditorías éticas, transparencia en los algoritmos, diversidad en los equipos de desarrollo, y leyes más estrictas que protejan nuestros derechos. La futura Ley de Inteligencia Artificial de la Unión Europea será clave, pero también lo será la conciencia social y el pensamiento crítico desde edades tempranas.

En resumen…

La IA no es el enemigo. Pero tampoco es un oráculo imparcial. Es una herramienta poderosa, y como tal, necesita vigilancia, ética y humanidad. Comprender sus sesgos es el primer paso para construir un futuro donde la tecnología sirva a todos, no solo a unos pocos.

"No se trata de apagar los algoritmos, sino de iluminarlos con justicia."

Comentarios

Publicar un comentario